Thèmes : économie, histoire, sciences, société.

Conférence du mardi 13 novembre 1990 par Jean-Claude Rouhet.

Jean-Claude Rouhet, directeur adjoint de la Société Aérospatiale Protection Système, nous a parlé mardi 13 novembre 1990 de « l’influence du facteur humain sur les accidents ».

Une panne de rétroprojecteur l’a empêché de projeter, comme prévu, des transparents. Nous nous en excusons auprès de Monsieur Rouhet et des auditeurs.

La Société Aérospatiale Protection Système est la filiale spécialisée du groupe Aérospatiale dans la maîtrise des risques, c’est-à-dire dans l’identification de tous les aspects de fonctionnement de grands systèmes, non seulement pour les produits fabriqués à l’Aérospatiale, mais également en diversifiant dans les domaines industriels comme les centrales nucléaires, les transports terrestres…

Les activités de la Société sont issues des études faites pour la sureté nucléaire de la force de frappe française, pour laquelle un certain nombre de méthodologies a été mis au point.

Qu’est-ce que la sécurité des systèmes ?

C’est l’actualité qui permet pour un système de mesurer la probabilité d’apparition d’un évènement qui a été choisi comme assez grave pour être qualifié d’évènement redouté.

Différentes sécurités :

- sécurité du travail

- sécurité de l’environnement

- sécurité de l’outil de travail

- sécurité informatique

- sécurité de l’investissement

Il faut maîtriser les mais aussi les peurs.

Différentes conceptions des aspects de sécurité peuvent être étudiées, depuis le domaine nucléaire civil jusqu’au domaine nucléaire militaire.

Dans le domaine nucléaire civil, on a un certain temps pour développer le système, on a de la place, on n’a pas de problème de poids et la sécurité se traduit simplement par la fiabilisation des systèmes de sécurité installés.

Dans le domaine nucléaire militaire, il faut un développement très rapide. Il n’y a pas beaucoup de place et le système lui-même doit fondamentalement être en sécurité. Dans ce cas, il faut démontrer la nécessité d’un système complémentaire.

Actuellement on parle beaucoup d’incidents dans les centrales nucléaires alors qu’il n’y a pas une seule contestation vis-à-vis du nucléaire militaire.

Pour le nucléaire civil, le gros problème n’est pas au niveau de la maîtrise des risques, mais plutôt au niveau de la gestion des peurs.

L’accident de Tchernobyl est arrivé car les systèmes de sécurité pour empêcher les accidents avaient été coupés.

Dans le domaine du nucléaire militaire, le système est en sécurité obligatoire et l’homme devra être intégré dans la conception du système nucléaire militaire.

Pourquoi installe-t-on des systèmes de sécurité ?

Il arrive que les systèmes de sécurité soient placés par habitude. C’est extrêmement dommageable, car cela ne permet pas de les adapter en fonction de l’avancement de la technologie et des besoins des opérateurs.

On peut également faire de la sécurité pour se conformer aux règlements.

Monsieur Rouhet nous a cité le cas du musée d’Orsay, où les systèmes de sécurité ont été installés pour se conformer aux règlements. On arrive ainsi à une aberration : dans la salle de contrôle qui gère l’ensemble de la sécurité, trois postes séparés ne dialoguent pas ensemble :

- centralisation technique généralisée (chauffage, climatisation, énergie…),

- sécurité incendie,

- contrôle (vol, attentat…). De très nombreuses caméras balaient le musée et un opérateur voit des séries d’images défiler sur des écrans (au bout d’un certain temps, il ne peut plus rien repérer).

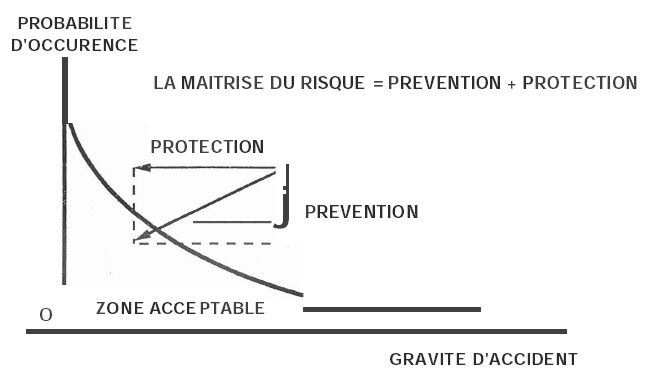

Quand il y a un risque, on peut, soit faire de la protection, soit faire de la prévention. Pour maîtriser le risque, il faut faire de la prévention et de la protection.

COMMENT MAITRISER LE RISQUE

La prévention, c’est l’ensemble des probabilités d’occurrence des évènements visant à réduire la probabilité d’occurrence des événements redoutés. Ce peut être :

- la fiabilisation des procédés,

- la mise en place de « barrières »,

- la formation du personnel,

- le confinement de l’activité.

La protection est l’ensemble des actions visant à réduire la gravité des conséquences d’un évènement redouté. Ce peut être :

- la mise en place de dispositifs,

- la mise en place de moyens de secours,

- la formation de personnels spécialisés,

- la création de plan d’intervention internes ou externes.

A ce stade de la conférence, Jean-Claude Rouhet nous montre un film vidéo qui rappelle :

1 – L’accident de CHALLENGER en janvier 1986

L’accident de Challenger provient d’un défaut même d’organisation. Au moment du lancement, la NASA savait que Challenger allait exploser.

Les faits :

1977 : Problème de joints d’étanchéité découvert par les ingénieurs de Thiokol lors des essais d’allumage des boosters.

Décembre 1982 : Sur base d’essais, la NASA porte le degré de criticité des joints d’étanchéité à 1 = peut causer la perte de la navette et de l’équipage.

Janvier 1985 : Procédure d’ajournement introduite, aucun vol ne peut être autorisé en cas de criticité 1.

Comme le haut management de la NASA n’a pas été averti du problème des joints, aucune requête n’est introduite.

Un ingénieur de Thiokol signale par écrit le risque d’explosion en cas de défaillance du joint.

Août 1985 : Les ingénieurs de Thiokol et de Marshall se rencontrent à Washington sur ce problème. Le haut responsable de la NASA manque à la réunion.

Décembre 1985 : Problème de joint d’étanchéité. L’ingénieur chef du projet de la Société Thiokol juge le problème résolu : un nouveau modèle est à l’étude, une solution est attendue.

23 janvier 1986 : Dans le document de la NASA intitulé « Marshal problem reports » figure la conclusion : « Problème considéré comme résolu ».

27 janvier 1986 : Une importante chute de température est redoutée la nuit précédant le vol.

L’ingénieur chef du projet de Thiokol au Centre Spatial Kennedy révise son jugement : il tente d’arrêter le lancement.

28 janvier 1986 : La navette challenger explose quelques secondes après le décollage. Les 7 membres de l’équipage sont tués.

Cause immédiate : le joint d’étanchéité.

2 – L’accident de CHERNOBYL en janvier 1986

Les essais faits dans la Centrale étaient sous l’autorité de groupes qui ne connaissaient rien en sureté nucléaire. Ils ont coupé tous les systèmes de sécurité « pour voir » l’effet que cela pourrait avoir.

Les faits :

25 avril 1986 – 13 h 00

Réduction de la puissance du réacteur afin d’obtenir les conditions nécessaires à une procédure de testing dans l’unité : 25 % de la puissance = 700 MW environ.

L’objectif : clôturer la procédure de test avant l’arrêt du réacteur pour la maintenance annuelle, le mardi suivant.

Le protocole du test était frustre. Les mesures de sécurité avaient été rédigées de manière purement formelle.

Le personnel décide de terminer le test sans l’autorisation formelle du groupe de sécurité technique.

Trois autres centrales du même type avaient refusé d’effectuer ce test pour des raisons de sécurité.

Les opérateurs chargés du test, des ingénieurs en électricité de Moscou n’étaient pas spécialistes de physique nucléaire.

25 avril 1986 – 14 h 00

Le système technique sur lequel le test est effectué (ECCS – Système de Refroidissement d’urgence du Réacteur) est déconnecté du réacteur.

Cette opération, dictée par le test, prive malheureusement le réacteur d’une de ses défenses principales.

25 avril 1986 – 14 h 00

La ville de Kiev demande à l’Unité 4 de maintenir la production d’électricité. Le système ECCS n’est pas reconnecté.

Bien que non significatif dans le déroulement de l’accident, ceci est significatif du laxisme des opérateurs à l’égard des règles de sécurité.

Suite à une production élevée de courant dans les 9 heures précédant le test, le taux de xénon était élevé, rendant difficile la conduite de la Centrale.

25 avril 1986 – 23 h 10

L’alimentation du réseau en électricité est interrompue.

26 avril 1986 – 00 h 28

Reprise du processus de baisse de puissance suite à une omission dans la procédure. La production de chaleur chute de manière excessive.

Dans ces conditions, le test aurait dû être abandonné.

Le commentaire de la Commission d’enquête soviétique « Le personnel n’était pas suffisamment familiarisé avec la physique d’un réacteur nucléaire… Il a perdu toute notion du danger encouru.

Le personnel s’efforce de maintenir ce régime de fonctionnement de plus en plus critique et instable afin d’achever le test.

26 avril 1986 – 01 h 22

Criticité maximale. Les opérateurs tentent en vain de mettre le réacteur hors service (SRAM).

26 avril 1986 – 01h 28

Explosion de la Centrale.

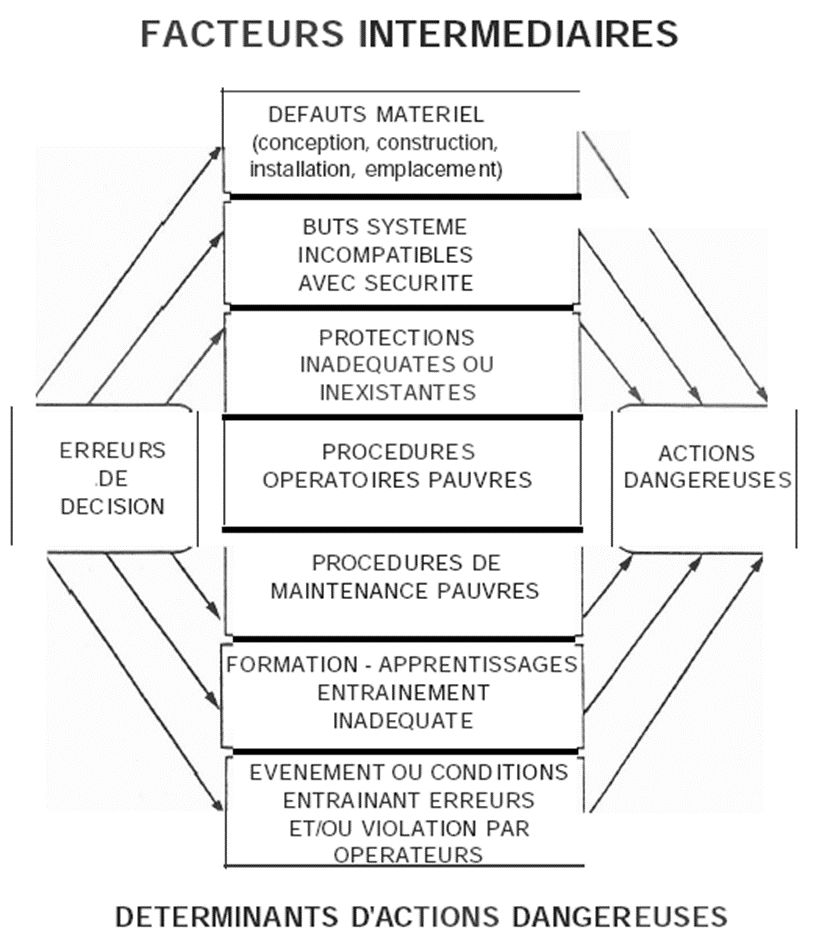

7 catégories de facteurs intermédiaires liés aux erreurs humaines déterminent l’accident.

3 – Herald of free entreprise – Mars 1987

Un ferry-boat est parti les portes ouvertes.

Les faits :

6 mars 1987 :

Le Herald est arrimé au quai 12 dans le port de Zeebrugge.

En raison de la marée haute, la procédure normale de chargement des véhicules n’est pas respectée : des véhicules sont canalisés sur le pont G.

18 h 05 :

Le Herald quitte la berge et se dirige vers le large. Ses portes de chargement internes et externes sont complétement ouvertes.

L’officier en chef vérifie qu’il n’y a pas de passagers sur le pont G. Il s’attend à ce que son assistant prenne en charge la fermeture des portes.

L’assistant est endormi dans sa cabine. II vient d’être relevé de tâches d’entretien et de nettoyage.

L’assistant fut le dernier à quitter le pont G. Il note que les portes sont ouvertes mais ne les ferme pas car il considère que cette tâche ne lui incombe pas.

L’officier en chef, responsable de la fermeture des portes, devait, sur ordre de la Compagnie, se trouver sur le pont 15 minutes avant le départ.

En raison de retards à Douvres, le personnel subissait une forte pression temporelle : ils étaient tenus de partir tôt.

18 h27 :

En quittant le port, le timonier augmente la vitesse.

Le Herald se couche sur le flanc.

Aucun indicateur de fermeture sur le pont.

Le timonier n’était pas averti de l’ouverture des portes.

Coût approximatif d’un indicateur : 5 000 FF environ !!!

Le système d’évacuation d’eau du pont est inefficace.

Le Herald appartient à une classe de navires intrinsèquement instables.

En 1985, l’INPO (Institute of Nuclear Power Operation) fit une analyse des causes premières significatives des incidents et des accidents.

- Comportement humain immédiat 52 %

- Déficiences de conception 33 %

- Fabrication 7 %

- Autres causes 8%

200 sur les 387 causes premières identifiées = 52 % concernent les facteurs humains.

Ventilation des problèmes concernant les facteurs humains

- Procédure ou documentation déficientes 43 %

- Manque de connaissance ou de formation 18 %

- Défaillance dans l’exécution des procédures 16 %

- Déficience de planification 10 %

- Défaut de communication 6%

- Défaut d’encadrement 3%

- Problèmes stratégiques 2%

- Autres 1%

En ce moment par exemple, des équipes d’Eurotunnel élaborent l’ensemble des procédures de fonctionnement des navettes dans le tunnel et dans les terminaux. Ils ont estimé à 7500 le nombre de procédures qui devront être écrites. Il faut mettre de plus en plus de systèmes informatisés pour aider les opérateurs à prendre leur décision, sans obligatoirement appliquer à la lettre des procédures qui ne peuvent s’appliquer dans toutes les circonstances.

Monsieur Rouhet nous cite l’exemple du train à grande vitesse japonais.

Il a été constaté que de plus en plus souvent des trains démarraient au feu rouge.

Dans ce train, tout est automatisé, de telle sorte que le conducteur n’a qu’une seule tâche, démarrer en gare, et détecter d’éventuels obstacles qui ne l’auraient pas été par les capteurs qui équipent les trains. Donc, pendant les heures de route, le conducteur n’a rien à faire. Il a un problème de sous-charge et d’endormissement.

***

Quand on fabrique un système, on part d’un modèle documentaire pour arriver à un modèle fini.

Le gros problème des aspects de sécurité est que très souvent personne ne s’est posé la question de savoir de quelle manière il va être utilisé. On imagine qu’il pourra être utilisé d’une certaine manière, mais on ne sait pas comment véritablement il sera utilisé.

Pour l’arme nucléaire seulement, il a été défini fondamentalement les objectifs de fonctionnement.

***

Monsieur Rouhet termine sa conférence en projetant un film sur l’accident du porte-avions Forrestal. Cet accident est typique d’une accumulation de tous les problèmes que l’on rencontre encore aujourd’hui dans le domaine général des systèmes. Il y a un problème de procédures, de formation… jusqu’à la conception même du navire.

Monsieur Rouhet compléta son exposé en répondant à des questions, notamment sur l’accident de Challenger.

Découvrez + de 1100 textes des conférences du CDI sur le site du CDI de Garches

Vos commentaires et vos conseils contribuent à l’amélioration de nos parutions.

Vous disposez de l’espace « COMMENTAIRES » ci-dessous pour les exprimer.

Merci et à bientôt pour votre prochaine visite.

Laisser un commentaire